O sistema operativo móbil iOS 13 tamén trae unha función moi interesante que permite que as aplicacións capturen diferentes tomas de diferentes cámaras do mesmo dispositivo, incluído o son.

Algo semellante funcionou no Mac desde os tempos do sistema operativo OS X Lion. Pero ata agora, o limitado rendemento do hardware móbil non o permitiu. Non obstante, coa última xeración de iPhones e iPads, mesmo este obstáculo cae e, polo tanto, iOS 13 pode gravar simultaneamente desde varias cámaras nun mesmo dispositivo.

Podería ser interesache

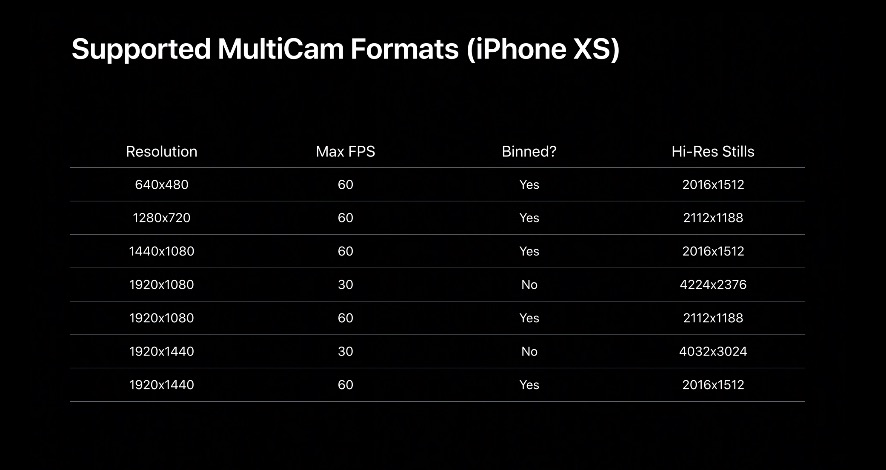

Grazas á nova API, os desenvolvedores poderán elixir desde que cámara toma a aplicación que entrada. Noutras palabras, por exemplo, a cámara frontal pode gravar vídeo mentres a cámara traseira toma fotos. Isto tamén se aplica ao son.

Parte da presentación na WWDC 2019 foi unha demostración de como unha aplicación pode usar varios rexistros. A aplicación poderá así gravar ao usuario e ao mesmo tempo gravar o fondo da escena coa cámara traseira.

Gravación simultánea de varias cámaras só en dispositivos novos

Na aplicación Fotos, era posible simplemente intercambiar ambos os rexistros durante a reprodución. Ademais, os desenvolvedores terán acceso ás cámaras frontales TrueDepth dos novos iPhones ou á lente gran angular ou telefoto da parte traseira.

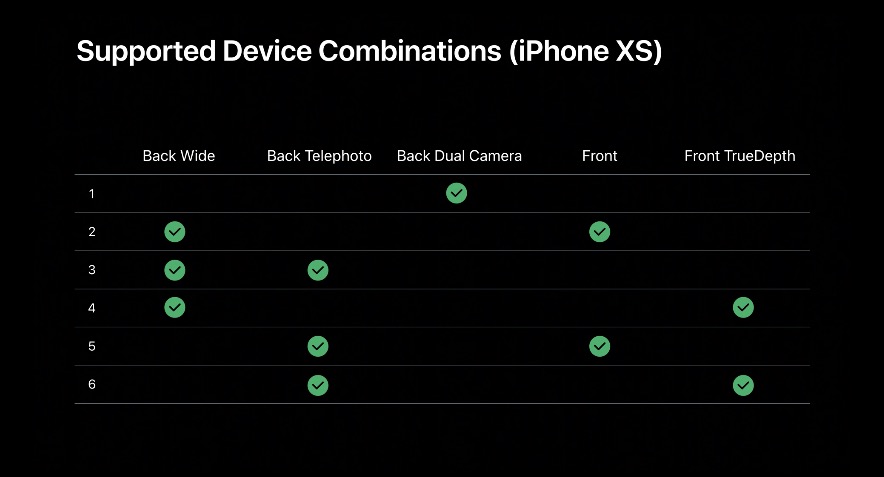

Isto lévanos á limitación que terá a función. Actualmente, só se admiten iPhone XS, XS Max, XR e o novo iPad Pro. Non hai outros dispositivos novos función en iOS 13 aínda non poden usalo e probablemente tampouco poderán facelo.

Ademais, Apple publicou listas de combinacións compatibles. Tras un exame máis detallado, pódese concluír que algunhas restricións non son tanto de hardware como de software, e Cupertino bloquea deliberadamente o acceso nalgúns lugares.

Debido á capacidade da batería, os iPhones e iPads só poderán usar unha canle de imaxes con varias cámaras. Pola contra, Mac non ten esa limitación, nin sequera os MacBook portátiles. Ademais, a función destacada probablemente nin sequera formará parte da aplicación Cámara do sistema.

A fantasía dun programador

Polo tanto, o papel principal será as habilidades dos desenvolvedores e a súa imaxinación. Apple mostrou unha cousa máis, e é o recoñecemento semántico dos segmentos de imaxe. Nada máis se oculta baixo este termo que a capacidade de recoñecer unha figura nunha imaxe, a súa pel, cabelo, dentes e ollos. Grazas a estas áreas detectadas automaticamente, os desenvolvedores poden asignar diferentes partes do código e, polo tanto, funcións.

Podería ser interesache

No obradoiro da WWDC 2019 presentouse unha aplicación que filmaba o fondo (circo, cámara traseira) en paralelo co movemento do personaxe (usuario, cámara frontal) e puido establecer a cor da pel de pallaso mediante rexións semánticas. .

Polo tanto, só podemos ver como os desenvolvedores adoptan a nova función.

Fonte: 9to5Mac