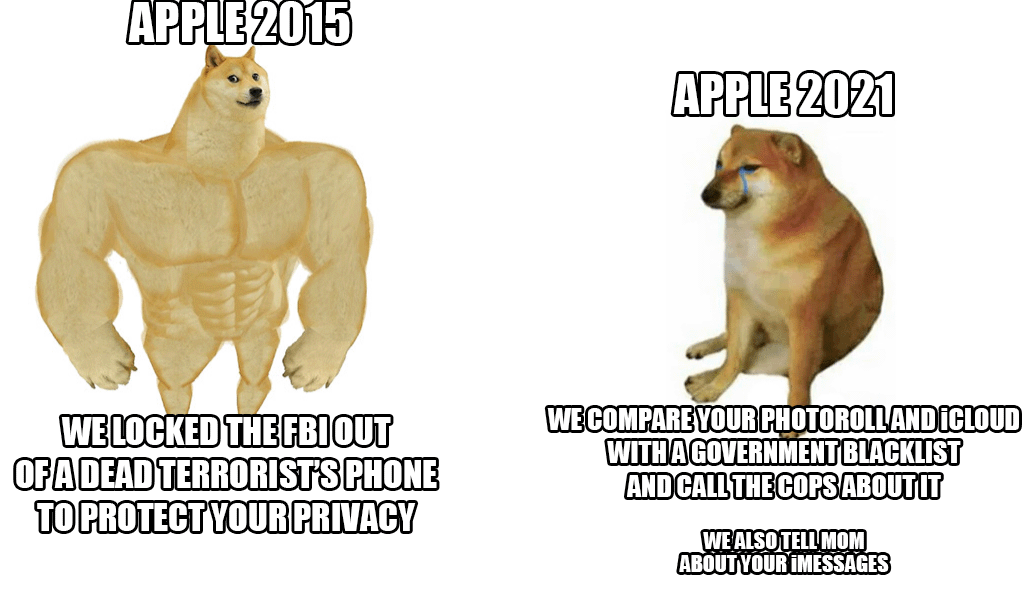

A finais da semana pasada, informámosvos dunha novidade bastante interesante, que é un novo sistema de detección de imaxes que representan o maltrato infantil. En concreto, Apple escaneará todas as fotos almacenadas en iCloud e, en caso de detectarse, informará destes casos ás autoridades competentes. Aínda que o sistema funciona "con seguridade" dentro do dispositivo, o xigante aínda foi criticado por violar a privacidade, o que tamén foi anunciado polo popular denunciante Edward Snowden.

Podería ser interesache

O problema é que Apple confiou ata agora na privacidade dos seus usuarios, que quere protexer en todas as circunstancias. Pero esta noticia perturba directamente a súa actitude orixinal. Os produtores de mazá enfróntanse literalmente a un feito consumado e teñen que escoller entre dúas opcións. Ou terán un sistema especial para escanear todas as imaxes almacenadas en iCloud, ou deixarán de usar as fotos de iCloud. Entón todo funcionará de forma sinxela. O iPhone descargará unha base de datos de hashes e despois compararaos coas fotos. Ao mesmo tempo, tamén intervirá nos informativos, onde se supón que debe protexer aos nenos e informar oportunamente aos pais sobre comportamentos de risco. A preocupación vén entón do feito de que alguén podería abusar da propia base de datos, ou peor aínda, de que o sistema podería non só escanear fotos, senón tamén mensaxes e toda a actividade, por exemplo.

Por suposto, Apple tivo que responder ás críticas o máis rápido posible. Por este motivo, por exemplo, lanzou un documento de preguntas frecuentes e agora confirmou que o sistema só escaneará fotos, pero non vídeos. Tamén o describen como unha versión máis amigable coa privacidade que a que están a usar outros xigantes tecnolóxicos. Ao mesmo tempo, a empresa da mazá describiu aínda con máis precisión como funcionará todo. Se hai unha coincidencia ao comparar a base de datos coas imaxes de iCloud, créase un vale criptográficamente seguro para iso.

Como xa se mencionou anteriormente, o sistema tamén será relativamente fácil de evitar, o que foi confirmado directamente por Apple. Nese caso, simplemente desactive Fotos en iCloud, o que facilita evitar o proceso de verificación. Pero xorde unha pregunta. Paga a pena? En calquera caso, a noticia brillante segue sendo que o sistema se está a implementar só nos Estados Unidos de América, polo menos polo momento. Como ves este sistema? Estarías a favor da súa introdución nos países da Unión Europea, ou é unha intromisión excesiva na privacidade?

Ben, é complicado. A protección da privacidade está, por suposto, case por encima de todo. Tamén é un dos motivos polos que uso esta plataforma. Pero todo ten os seus límites. En definitiva, toda liberdade remata onde atenta contra a liberdade allea. Está claro que hai que tomar medidas contra alguén que estea disposto a prexudicar ou abusar dos nenos. Iso é sen debate.

Como xa se mencionou anteriormente, o sistema tamén será relativamente fácil de evitar, o que foi confirmado directamente por Apple. Nese caso, simplemente desactive Fotos en iCloud, o que facilita evitar o proceso de verificación.

Porque ao mesmo tempo significa desactivar o álbum compartido. Que sinxelo querido Watson :)

Rebuscar automaticamente nas fotos sen a autorización da autoridade designada é incorrecto en principio, e aposto a que este é só o primeiro paso. Hai tantas cousas que se poden facer que nun primeiro momento son xustificables e despois xa non se poden parar Pornografía infantil-> comercio de carnes brancas-> crueldade cos animais -> non facer caso de conducir -> participación nos actos da oposición festas...

O problema é o que fai posible este proceso. Por que o fabricante do teléfono e do SO ten que dicirnos o que hai que ter nel como usuario? Por suposto, especialmente os nenos axeitados, é moi agradable escoitar, polo que Apple incluso patrocina un dispositivo de última xeración que trata este tema. Por que o solucionan as organizacións sen ánimo de lucro, porque aos nenos non lles interesa o Estado? Realmente non me molesta se non estou facendo nada mal, pero fan posibles criminais de cada usuario de iPhone/iPad. Esta é unha lóxica retorta, eu diría que unha das solucións máis sinxelas, escanearemos as túas fotos con seguridade. Entón, todos os que me envían pornografía infantil a través de iMessage están frustrados porque son un delincuente e serei responsable ante unha empresa privada por algo que non me interesa e, mentres tanto, non vou iniciar sesión porque o DNI será bloqueado. E todas as persoas frustradas que son tan estúpidas que comparten fotos dos seus fillos e as copian na nube, irán a outro lado porque as persoas máis estúpidas quedan atrapadas por isto. Ademais un par de pais que accidentalmente sacaron unha foto á súa descendencia cun pindik/pipinka. Ben xogado.

Por que atraparían aos pais que lle tiraron unha foto á súa prole espido? Non funciona así

Si, escribín mal, polo que probablemente non funcione. E máis aló?